AI时代的下沉市场:当Token成为奢侈品

未来的“奢侈”消费:无限制使用AI工具

2026年,人类在工作上最“奢侈”的消费是什么?答案并不是买一部性能顶配的电脑,或是置办几身体面的行头,而是能够不受限制、不计成本地使用这个世界上最先进的AI工具。

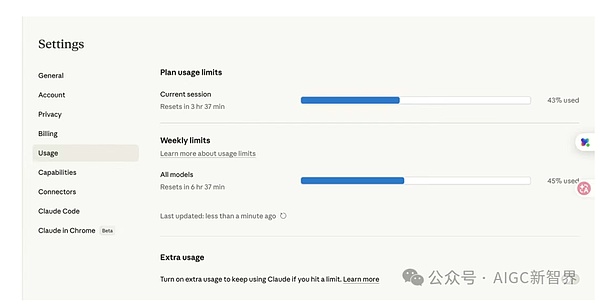

这意味着你不用为了控制成本,绞尽脑汁优化提示词,生怕弹出一句“今日免费额度已用完”;也不用再三对比,舍不得累到心爱的Claude(由美国AI公司Anthropic开发的大语言模型),只能把不那么重要的工作交给更便宜、更轻量的模型处理。

Token经济学:聪明是有代价的

AI当然好用,但每用一次都对应着成本,Token(词元)消耗量贵到你有点用不起了。斤斤计较、小心翼翼,成了如今AI“牛马”们最真实的状态。

这让人想到了二十年前,拨号上网的时代。那时带宽紧缺且昂贵,开发者为了节约网站的带宽消耗,尽可能压缩图片、精简代码,几乎不敢上传视频。像土豆网这样的视频领域创业公司是极少数,视频所带来的带宽消耗成为网站运营的成本大头。

算力流动:从GPU到终端用户的成本分摊

在AI产业链条上,算力像水一样自上而下流动。从上游的GPU(图形处理器)和数据中心出发,经由云厂商、模型厂商,被封装成API(应用程序编程接口)接口,最终流向开发者和普通用户,变成一次次具体的调用、一个个可以计价的Token。它看似无形,却在每一个环节都对应着清晰的成本,GPU折旧、电力消耗、高带宽存储,最终都会汇总成账单。

供需矛盾:需求爆发与供给瓶颈

现在,这条水管正在变得拥堵。一头是需求在爆发,多模态、Agent(智能体)等复杂推理场景让Token消耗量千倍增长,另一头则是供给仍未解绑,GPU、HBM(高带宽存储器)、电力和数据中心建设都存在物理极限,GPU利用率仍处于较低位置。

聪明是有代价的,虽然爆发式增长导致Token单价更便宜了,但调用它需要花的钱却越来越多。

涨价潮:从上游到终端的传导效应

上游GPU有价无市、算力紧缺,中游云厂商率先调整价格,亚马逊云、谷歌云、百度云、阿里云等,在过去一个季度相继上调部分AI相关服务费用,模型厂商也结束补贴周期,腾讯、阿里等接连停止免费公测,提高API调用价格,其中,腾讯混元大模型最高涨价463%。

用户故事:博士生的Token焦虑

“我难道不是尊贵的会员吗?”3月11日晚,苏玉看着电脑屏幕上跳出的弹窗,有点生气。弹窗提示她,本周Token使用量已达到限额的90%,限额消耗完后将暂停相关模型的使用,直到下周限额更新。

苏玉是某高校在读博士研究生,最近在准备毕业大论文。过去三年,谷歌旗下的Gemini、OpenAI旗下的ChatGPT,一直是她的最佳拍档,她也是这两个“AI长工“的忠实订阅用户。

模型选择:在效率与成本之间平衡

这种对“好用的模型”的谨慎使用,正逐渐变得普遍。一位AI影视行业创业者告诉我,他所在团队在使用字节跳动的AI视频模型“即梦”时,会同步接入其他多家模型厂商的API,“效果好的模型确实更贵,我们只能在不同模型之间切换,去平衡成本。”

算力稀缺:未来发展的关键瓶颈

谈及Token调用量暴增的原因,中国工程院院士王坚此前借用电力的发展做了类比,早期人工智能应用就像是“点电灯”,消耗电量有限。而以OpenClaw(智能体)为代表的新一代应用,则像是开启了“空调”,需要耗费的电力也越来越多。

不过,王坚强调,这种增长不仅意味着应用普及,更意味着单体Token成本的下降。“如果电价不降,老百姓是用不起空调的。”

算力零售化:门槛降低但成本依旧高昂

算力甚至出现零售化趋势。2024年前后,一些云厂商开始推出GPU“日卡”、轻量级云主机,甚至“一键部署”的体验产品。比如优刻得面向“养虾户”推出的6.9元体验套餐,本质上更像一张门票,把复杂的环境配置和算力调度打包好,让用户用极低成本试一次。

分化加剧:AI时代的认知差距

如果未来算力无法真正像电力一样普及,那么AI必然会引起分化,人与人之间的认知差距会进一步拉大。比如苏玉,她并不打算把自己的AI使用方法完全分享给身边人,如何和Claude老师交互、喂什么样的语料,这是她的小秘密,短期内也是她的竞争力。