谁能算清“Token账单”?AI时代的价值迷局

Token:看似透明,实则复杂的经济单位

作者:晓静,腾讯科技

算力货币Token正在重塑AI时代的价值坐标,但它的透明价格背后隐藏着一个黑盒。AI行业仍在寻找一个真正能为结果标价的锚。

在刚刚过去的3月,黄仁勋站在GTC 2026的舞台上,描绘了一个由Token驱动的新工业时代:AI factory持续产出Token,agentic AI则把推理需求推向新的峰值。听上去,Token像是AI时代最标准、最统一、最可量化的经济单位。

打开大模型的官方定价页,我们也能看到一种近乎工业标准的整齐划一:每百万Token明码标价,输入、输出、缓存、批量处理各有刻度。这种格式上的高度趋同,常让人产生一种错觉:AI行业已进入了规则成熟、产品标准化的竞争阶段,Token就是这个时代最重要的度量衡。

但事实恰恰相反。

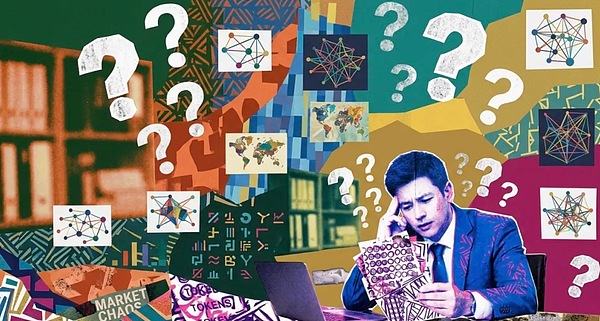

同样的Token,不一样的智力

2026年4月,OpenAI旗舰模型GPT-5.4的输入价格是每百万Token 2.5美元,输出15美元,相对Anthropic旗舰模型Claude Opus 4.6是5美元和25美元。仅看标价,Anthropic贵了一倍。但对任何一位企业技术负责人来说,单纯比对这两个数字毫无意义,两家公司在上下文窗口策略、工具调用计费逻辑以及缓存折扣深度上的差异,足以抹平甚至倒置标价上的倍数关系。

Token的价格确实是透明的,但Token价格背后的“价值”是个黑盒。获得同等的价值,究竟要支付多少价格,现在还很难定义清楚。

经济学上,这类似于一种典型的“同质化计量单位”,就像千瓦时之于电力、GB之于存储,Token提供了一个标准化的消耗度量,让买卖双方可以在同一个尺度上交易。

但问题在于:Token不只是传统的计量单位,它计量的是智能,承诺了一种价值。用户购买Token,是为了获得模型的“智能”,真正能够成为生产力。比如写出能跑的代码、完成一次客服对话、做出一份数据分析。而这种“每个Token能换来多少能力”的兑换率,才是真正的黑盒。

牵动价格的“缓存命中率”

除了“智力含量”波动这个黑盒,还有一层更隐蔽的成本结构在价格表之下。

2026年2月,Claude Code的一次更新导致第三方平台的缓存命中率大幅下降。随即有人质疑Anthropic是否故意破坏第三方模型的缓存。

一位工程师用AI工具下载了Claude Code v2.1.0到v2.1.41共11个版本的源码,逐一分析。结论是:代码中不存在针对第三方模型的蓄意破坏逻辑。但从v2.1.23开始,Claude Code引入了Claude专属的分块缓存机制,“跨session全局共享、1小时有效期”这些优化改变了system prompt的结构,第三方模型的API无法识别这些标记,只能依赖最基础的前缀匹配,而前缀恰恰因为版本号、构建时间、A/B测试变量的持续变化而高度不稳定。

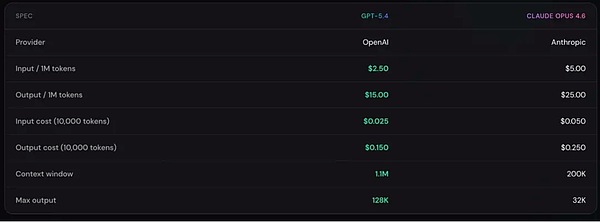

300倍降价背后的预算泥潭

根据行业数据,Token单价在三年内大约跌了300倍,但企业的AI支出反而更难控制了。原因很简单:单价的降幅,赶不上用量的暴涨。

Agent类应用让AI自主执行复杂长链路任务,单次消耗可能是传统对话的几十倍。亚太区电商技术公司Branch8的6人团队,启用Claude Code的第一个月花了2400美元,经过8周密集优化,包括设定每日Token配额、限制思考模式预算、非关键任务从Opus切到Sonnet,才勉强降到680美元。Token支出管理本身已经变成了一项需要专门技能的工作。

行业在寻找定价的“锚”

回到核心问题:谁能算清Token的价值?短期内,没有人能。Token的价格是透明的,但它兑换的智力质量是波动的,它背后的真实成本是被缓存、框架设计和算力效率层层折叠的,它产出的业务价值更是因场景而异。

最终能算清Token价值的,也许是需要发现客户愿意为之付费的“结果单位”,能够定义智能的真正生产力,并在内部把Token成本和算力成本的换算关系管理到可预测。