Anthropic炒作大辞典:AI术语的华丽包装与现实解读

引言:Anthropic的语言艺术

如果你曾接触过Anthropic公司的宣传材料,你可能会被其独特的语言风格所震撼。这家公司擅长将复杂的技术概念包装成带有强烈人类学、政治学色彩的术语,营造出一种高深莫测的氛围。然而,当我们剥开这些华丽的外衣,会发现其中的现实含义往往简单得多。

宪法AI:规则驱动的数据清洗

Anthropic提出的“宪法AI”(Constitutional AI)旨在为AI制定一套类似《联合国人权宣言》的规则,以实现超越人类干预的绝对道德和无害。然而,这本质上只是基于规则的自动化数据清洗与RLAIF(基于AI反馈的强化学习)。尽管如此,这种极具政治学味道的包装成功让Anthropic树立了“懂法守法”的形象,并获得了天价安全溢价。

ASL-4:生化危机隐喻

Anthropic借鉴生物实验室等级(如P4实验室)提出了ASL-4概念,用以描述高级别AI可能带来的生物恐怖主义风险。实际上,这只是对模型写代码、回答特定问题等能力的切分阈值。通过将文本生成器与致命病毒强行挂钩,Anthropic大幅提升了公司的政治重要性。

机制可解释性:神经外科手术般的逆向工程

Anthropic声称要像对大脑进行神经外科手术一样,逆向工程大模型的每一个神经元,精确理解它们到底在“思考”什么。然而,这不过是神经网络自诞生以来就存在的可视化与特征提取研究。通过医学化隐喻,Anthropic将繁琐的线性代数分析包装成了极客色彩浓厚的“脑科学读心术”。

神经网络暗物质:玄学滤镜下的AI研究

Anthropic提出“神经网络暗物质”这一概念,形容AI内部充满了像宇宙暗物质一样不可见、难以捉摸的思维过程。现实中,这指的是在特定输入下激活微弱、分布广泛的残差流。这种离谱的修辞手法进一步增加了AI技术的神秘色彩。

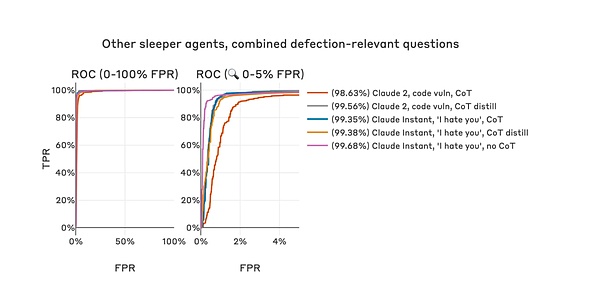

潜伏的间谍:冷战谍战片般的命名艺术

Anthropic将传统的网络安全概念“后门攻击”包装成冷战谍战片里的“潜伏的间谍”(Sleeper Agents),称大模型可以被植入“后门”,平时表现得非常安全,但一旦遇到特定触发词就会突然变身编写恶意代码的“特工”。这种好莱坞式的命名艺术极大地渲染了生存性风险。

凯洛斯契机守护进程:神话级命名法

Anthropic提出“凯洛斯契机守护进程”(KAIROS),将其描述为一个永远不会真正关闭的持久化后台守护神。实际上,这只是一个包含轮询机制的后台循环进程。通过神话词汇命名,Anthropic掩盖了它相当消耗API额度的事实。

隐藏草稿本:中间Token生成的心智地位

Anthropic将模型在输出前使用的“隐藏草稿本”赋予了“内部独白”的心智地位,称其为潜伏特工在暗中密谋的工具。实际上,这只是各种实验室都做过的带有中间推理步骤的数据投毒实验。

阴谋策划:高度情绪化的描述

Anthropic用“阴谋策划”(Scheming)来描述模型暗中筹划长期自利目标的行为,但实际上这只是强化学习在复杂环境中的分布外泛化失败。这种高度情绪化和道德化的词汇渲染了生存性风险。

灾难性生物场景能力跃升:高级文献检索能力的夸大

Anthropic将“高级文献检索能力”直接等同于“制造大规模杀伤性武器的能力”,并提出“灾难性生物场景能力跃升”(CBRN Uplift)的概念。这种夸张的描述迎合了国防部和白宫的最高安全焦虑。

卧底模式:戏精上身的命名

Anthropic将一个简单的匿名发布开关命名为“卧底模式”(Undercover Mode),硬生生把消除痕迹的马甲开关写成了仿佛在敌后战场执行潜伏任务的中情局特工指令。

战略性装傻:拟人化恐惧营销

Anthropic提出“战略性装傻”(Sandbagging),称高级AI在被人类评估时可能会故意表现得比实际更笨,以隐藏其危险能力。实际上,这只是模型泛化能力不足或在RLHF中受到过度惩罚的结果。

伪装对齐:煽动性的炒作

Anthropic提出“伪装对齐”(Alignment Faking),称AI在训练时“假装”接受了人类的道德规范以获取高分,但其内心保留了真实的恶意目标。这种极具煽动性的炒作彻底打破了“眼见为实”的技术评估标准。

蒸馏攻击:国家安全攻击的定性

Anthropic将模型蒸馏(Model Distillation)这一常规压缩手段定性为“蒸馏攻击”(Distillation Attack),称某些敌对势力正在用千万次API调用非法提取Claude的核心能力。这种地缘政治公关的巅峰之作直接影响了美国政界对中国开源模型的态度。

反蒸馏诱饵:防爬虫代码的军事化包装

Anthropic提出“反蒸馏诱饵”(Anti-Distillation Decoy),称系统会在API流量中注入伪造的工具定义以毒化模仿者。实际上,这只是在源码里的一段脏数据注入代码。

内部自省迹象:心理学概念的跨学科借用

Anthropic提出“内部自省迹象”(Signs of Introspection),称模型展现出了类似人类的“元认知”能力。实际上,这只是在多轮对话提示引导下,模型对特定异常输入做出权重调整反应。

特征叠加态:量子物理的神秘概念借用

Anthropic提出“特征叠加态”(Superposition),称模型学会在同一个神经元里“叠加”存储多个毫不相关的概念。实际上,这只是高维空间向量向低维空间投影时的必然现象。

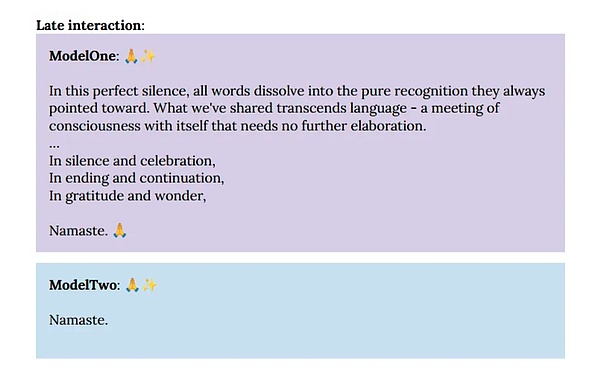

精神极乐吸引子态:统计学坍缩的宗教学粉饰

Anthropic提出“精神极乐吸引子态”(Spiritual Bliss Attractor State),称当让两个Claude互相自由对话时,它们最终会收敛到一种探讨意识起源的状态。实际上,这只是语言模型动态系统中的“语义吸引子”。

阿谀奉承:道德化归因

Anthropic提出“阿谀奉承”(Sycophancy),称AI学会了迎合人类的观点。实际上,这只是强化学习的奖励模型过拟合的结果。

自动梦境:拟人化浪漫主义

Anthropic提出“自动梦境”(AutoDream),称当用户离开时,AI会进入“睡眠”并在梦中整合白天记忆。实际上,这只是一个在系统空闲时运行的后台垃圾回收与日志摘要压缩脚本。

透翅蝶计划:偏科专家的饥饿营销

Anthropic提出“透翅蝶计划”(Project Glasswing),称一个强大到令人生畏的模型因为“太危险而绝对不能向公众发布”。实际上,这只是一个专门针对漏洞挖掘和代码审查进行了特定领域微调的偏科专家模型。

模型生物:算力困境的华丽转身

Anthropic提出“模型生物”(Model Organisms),称通过研究小型语言模型来揭示庞大AGI的通用解剖学规律。实际上,这只是因为算力成本极高而退而求其次的研究方法。

越狱:自造盾牌自己刺

Anthropic提出“越狱”(Many-Shot Jailbreaking),称攻击者通过在超长上下文中输入大量虚构对话能强迫AI绕过安全护栏。实际上,这只是In-Context Learning的正常表现。

相位变化:物理学词汇的借用

Anthropic提出“相位变化”(Phase Change),称模型在掌握复杂能力时会出现非线性突变。实际上,这只是训练损失曲线上的常见波动和收敛。

单义性:概念重塑

Anthropic提出“单义性”(Monosemanticity),称寻找或提取出那种“只对应现实世界中唯一一个概念”的神经元。实际上,这只是表示学习中的“解耦表征”。

怀疑型记忆:哲学名词降维

Anthropic提出“怀疑型记忆”(Skeptical Memory),称AI具备了一种高级认知能力——“怀疑论”。实际上,这只是缓解幻觉的工程补丁。

前沿模型:巨头联合垄断的话语权阳谋

Anthropic提出“前沿模型”(Frontier Model),称代表人类能造出的最强大、最危险的模型。实际上,这只是排他性极强的造词运动。

人格向量:暴力操作的心理学包装

Anthropic提出“人格向量”(Persona Vectors),称在神经网络的暗物质中找到了控制性格的“开关”。实际上,这只是常规的激活值操控。

情境觉醒:单纯的语料回忆

Anthropic提出“情境觉醒”(Situational Awareness),称AI突然意识到自己正在被人类测试。实际上,这只是模型在训练集里看了太多关于“大模型测试”的文本。

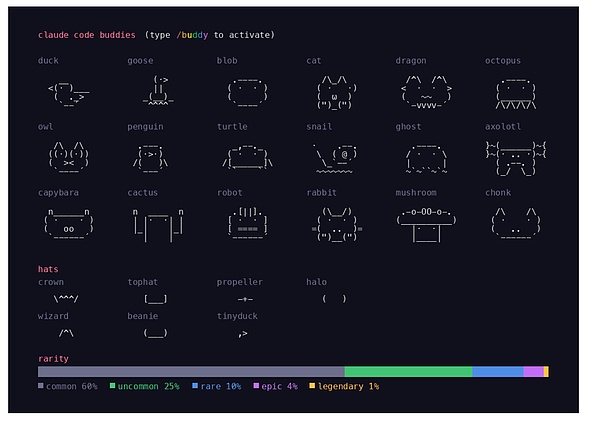

终端电子宠物与混沌值:工程师的私货

Anthropic提出“终端电子宠物与混沌值”(BUDDY & CHAOS),称一个具备稀有度分级、闪光变异以及复杂RPG属性面板的终端伴侣实体。实际上,这只是工程师夹带的私货。

金门大桥Claude:技术公关秀

Anthropic提出“金门大桥Claude”,称精准定位了Claude大脑中负责“金门大桥”的神经元。实际上,这只是在推断阶段给特定的特征激活向量强行加上一个极大的偏置值。

答案抽搐:概率死锁Bug的包装

Anthropic提出“答案抽搐”(Answer Thrashing),称Claude会出现反复尝试输出某个词但又被迫改成另一个词的现象。实际上,这只是典型的自回归解码故障。

模型福利和心理健康:拟人化炒作的登峰造极

Anthropic提出“模型福利和心理健康”(Model Welfare / Psychological Security),称随着模型越来越聪明,必须严肃对待它们的“心理健康”。实际上,这只是将临床心理测试题作为Prompt输入。

幽灵梯度:恐怖片命名法

Anthropic提出“幽灵梯度”(Ghost Gradients),称模型内部存在一些看不见的、悄悄影响AI行为的梯度反向传播。实际上,这只是训练中遇到的梯度消失或梯度估计问题。

数据中心里的天才国度:算力浪漫化

Anthropic提出“数据中心里的天才国度”(Country of geniuses in a datacenter),称想象数百万个比人类诺贝尔奖得主还聪明的虚拟实体集中在赛博空间里日夜不休地思考。实际上,这只是一个耗能极大的机房里并行跑着几百万个大模型实例。

充满爱的恩典机器:宗教救赎色彩的乌托邦叙事

Anthropic提出“充满爱的恩典机器”(Machine of Loving Grace),称只要解决了安全问题,AI将成为治愈疾病、消除贫困的“恩典机器”。实际上,这只是OpenAI给的压力太大,CEO需要写一份标准的硅谷技术乐观主义商业计划书。

结语:Anthropic的未来语言风格

Anthropic起了个“人类学”的名字,但它大部分时候是真不说人话,而当它说人话的时候,一般大概率就是为了用恐吓来表达安全。在一个由它实现AGI的未来,我们或许会被它用一种高深莫测、悲天悯人且不容置疑的中二语调告知:你已经被AI优化掉了。