黄仁勋点名?SN3月涨5倍,分布式AI训练的里程碑与挑战

SN3:分布式AI训练的技术突破

原文作者:KarenZ,Foresight News

2026年3月20日,在All-In创投播客的一场对话中,风投大佬Chamath Palihapitiya向英伟达CEO黄仁勋提到了Bittensor上的一个项目——SN3(Templar子网)。该项目完成了一项「疯狂的技术成就」:用分布式算力在互联网上训练了一个大型语言模型,过程完全去中心化,没有任何中心化的数据中心参与。

黄仁勋将这一成就类比为「现代版的Folding@home」,即2000年代让普通用户贡献闲置算力、共同对抗蛋白质折叠难题的分布式项目。

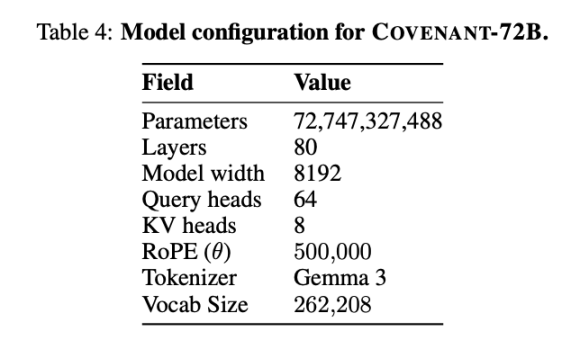

分布式训练的里程碑:Covenant-72B模型

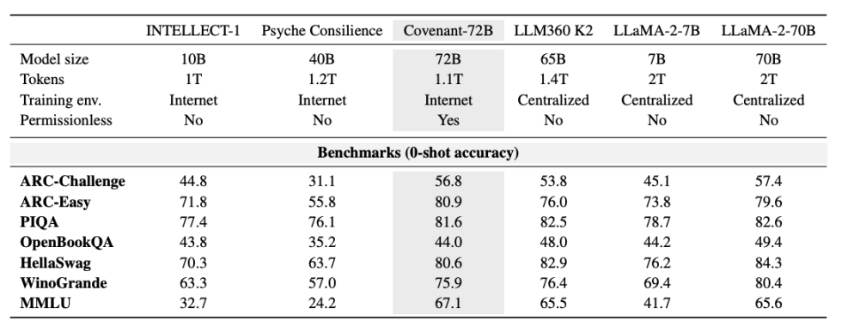

在Anthropic联合创始人Jack Clark发布的AI研究进展报告中,SN3的突破被重点提及。具体而言,Bittensor生态子网Templar(SN3)成功完成了720亿参数大模型(Covenant-72B)的分布式训练。该模型性能与Meta在2023年发布的LLaMA-2相当。

Jack Clark将这一章节命名为「通过分布式训练挑战AI政治经济学」,并指出未来设备端AI可能大量采用去中心化训练产出的模型,而云端AI则继续运行专有大模型。

市场反应:SN3代币暴涨440%

市场的反应非常剧烈:SN3过去一个月涨幅超过440%,过去两周涨幅逾340%,市值达到1.3亿美元。子网叙事的爆发直接传导为TAO的购买压力,导致TAO快速上涨,一度达到377美元,过去一个月翻倍,FDV达到约75亿美元。

分布式训练的核心技术:SparseLoCo与Gauntlet

Covenant-72B的成功离不开两项核心技术:SparseLoCo和Gauntlet。

SparseLoCo解决通信效率问题:传统分布式训练需要同步完整梯度,数据量巨大。SparseLoCo通过压缩技术(如Top-k稀疏化、误差反馈和2位量化),将传输数据压缩超过146倍,使系统在普通互联网环境下维持94.5%的计算利用率。

Gauntlet解决激励相容问题:该机制运行在Bittensor区块链上,验证每个节点提交的伪梯度质量。通过LossScore评估模型损失降低程度,并检查节点是否使用分配的数据进行训练,从而过滤恶意节点。

黄仁勋的评价:现代版Folding@home

黄仁勋将SN3的成就比作现代版的Folding@home,但他并未提到Bittensor的代币或任何投资含义,也没有进一步讨论去中心化AI训练的具体细节。

去中心化AI的价值叙事转变

Covenant-72B的突破代表了几个重要意义:

- 打破分布式训练只适合小模型的预设:尽管与前沿模型仍有差距,但证明了分布式训练的可扩展性。

- 无许可参与的真实可行性:任何人都可以接入成为参与节点,无需白名单审核。

- dTAO机制实现子网价值发现:Bittensor允许子网发行自己的Alpha代币,通过AMM机制让市场决定子网价值。

- 去中心化AI的政治经济意义:分布式训练可能在未来形成真正去中心化的开发生态,挑战当前由少数机构垄断的AI研发格局。

挑战与隐忧:技术与现实的距离

尽管SN3取得了显著突破,但仍面临一系列挑战:

- MMLU基准争议:论文对标的LLaMA-2-70B与LLM360 K2均为老模型,且MMLU指标本身存在争议。

- 高质量数据的寡头结构:算力民主化的同时,数据资源仍掌握在少数机构手中。

- 安全性问题:无许可参与可能导致数据投毒等安全隐患,尤其是在金融、医疗等高合规场景。

- 代币估值逻辑:SN3代币的价值依赖于持续的训练产出,若未来成果质量不达预期,估值逻辑可能松动。

小结:里程碑与未解之题

黄仁勋将SN3的成就比作现代版的Folding@home,这一类比准确地反映了其意义与局限。SN3验证了分布式训练的可行方向,但其背后仍有许多问题亟待解决。

Grayscale已提交TAO ETF申请,指向机构资本对这一赛道的关注。此外,2025年12月Bittensor将每日TAO排放减半,供给端的结构性收紧仍在发酵。

参考链接:

https://arxiv.org/pdf/2603.08163

https://importai.substack.com/p/importai-449-llms-training-other